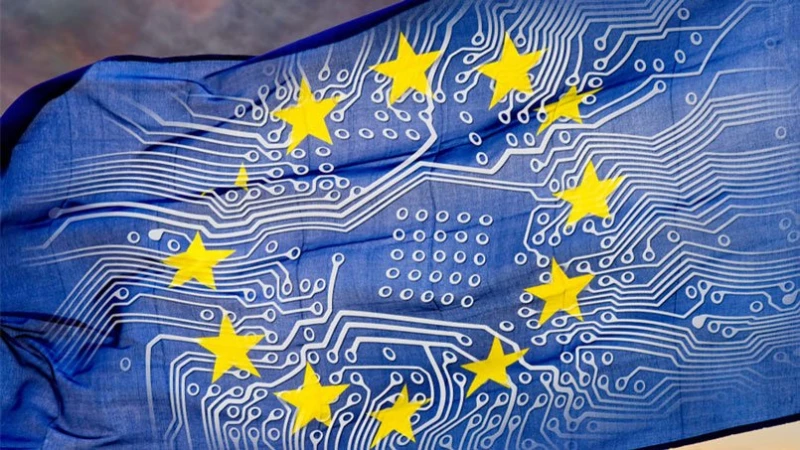

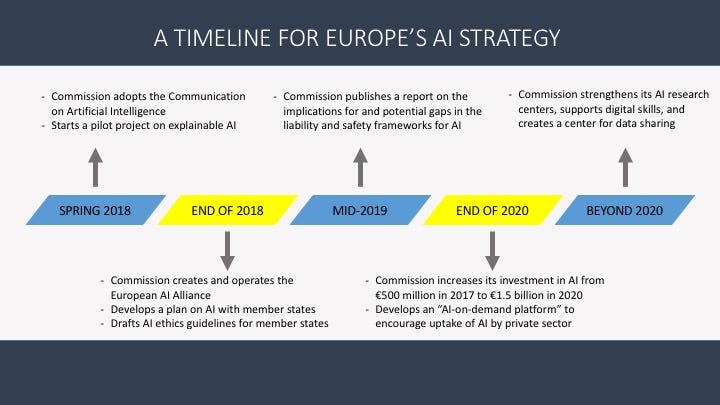

Η τεχνολογία που σπέρνει το μεγαλύτερο φόβο στις καρδιές των ανθρώπων αυτή τη στιγμή είναι η τεχνητή νοημοσύνη. Είναι επίσης και το εργαλείο που υπόσχεται να αλλάξει προς το καλύτερο την ανθρωπότητα και για αυτό το λόγο δημόσιοι φορείς αλλά και εταιρίες δημιουργούν ερευνητικά κέντρα περί ηθικής για την ανάπτυξη της τεχνητής νοημοσύνης. Πλέον και η Ευρωπαϊκή Επιτροπή, έδωσε στη δημοσιότητα τις δικές της οδηγίες για την ανάπτυξη μιας AI την οποία “μπορούμε να εμπιστευτούμε”.

Οι εφτά πυλώνες της Ευρωπαϊκής Ένωσης βασίζονται στο σεβασμό την ανθρώπινης αυτονομίας, στην πρόληψη της ασφάλειας, στο δίκαιο και στην ανάληψη ευθυνών. Ειδική προσοχή πρέπει να λάβουν ευαίσθητες ομάδες πληθυσμού, όπως τα παιδιά και άτομα με ειδικές ανάγκες.

/cdn.vox-cdn.com/uploads/chorus_image/image/63372197/Screen_Shot_2019_04_08_at_1.36.11_PM.0.png)

- Ανθρώπινος παράγοντας και επίβλεψη: Τα AI συστήματα πρέπει να υποστηρίζουν ισότιμες κοινωνίες υποστηρίζοντας την ανθρώπινη διοίκηση και τα ανθρώπινα δικαιώματα και να μη μειώνουν, περιορίζουν ή παραπλανούν την ανθρώπινη αυτονομία.

- Ακεραιότητα και ασφάλεια: Η αξιόπιστη AI πρέπει να έχει αλγορίθμους ασφαλείς, αξιόπιστους και ισχυρούς ώστε να αντιμετωπίζει σφάλματα και ασυνέπειες κατά τη διάρκεια των φάσεων των κύκλων ζωής των AI συστημάτων.

- Ιδιωτικότητα και διαφύλαξη των δεδομένων: Οι πολίτες πρέπει να έχουν τον πλήρη έλεγχο των προσωπικών τους δεδομένων, ενώ δεδομένα που τους αφορούν δε θα χρησιμοποιούνται για να τους βλάψουν ή να τους διακρίνουν έναντι άλλων.

- Διαφάνεια: Πρέπει να διασφαλίζεται η ανιχνευσιμότητα των AI συστημάτων.

- Διαφορετικότητα, μη-διάκριση και δικαιοσύνη: Τα AI συστήματα πρέπει να λαμβάνουν υπόψη όλη τη γκάμα των ανθρώπινων ικανοτήτων, δεξιοτήτων και απαιτήσεων για να διασφαλίζουν την προσβασιμότητα.

- Κοινωνική και περιβαλλοντική ευημερία: Τα AI συστήματα πρέπει να χρησιμοποιούνται για να ωθούν τη θετική κοινωνική αλλαγή και να υποστηρίζουν τη βιωσιμότητα και την οικολογική ευθύνη.

- Ανάληψη ευθυνών: Πρέπει να δημιουργηθούν μηχανισμοί που θα διασφαλίζουν την ανάληψη ευθύνης και τη λογοδοσία για τα AI συστήματα και τα αποτελέσματα αυτών.

Οι οδηγίες της Ευρωπαϊκής Ένωσης δεν εμπλέκονται ακόμα στις νομοθεσίες των κρατών και διατηρούν προς το παρόν ένα χαλαρό πλαίσιο. Από αυτό το καλοκαίρι η Επιτροπή θα μελετήσει ποιοι τομείς χρειάζονται καθοδήγηση, ενώ από το 2020 η European AI Alliance θα αρχίσει να εφαρμόζεται σε πιλοτικό στάδιο με τη συμμετοχή κρατών, οργανισμών και εταιριών.

Must Read

Ο σεναριογράφος του Taxi Driver λέει ότι οι AI ηθοποιοί είναι το μέλλον του Χόλιγουντ

Εταιρεία χρεώθηκε $500 εκατομμύρια λόγω ανεξέλεγκτης AI χρήσης από τους υπαλλήλους της

Οι χρήστες παρατούν το AI search της Google για χάρη του DuckDuckGo